Com 1 milhão de CPUs, Horizon é o novo supercomputador dos EUA

Novo equipamento usa processadores plataforma Nvidia Grace Blackwell, tem 4 mil GPUs Nvidia tem capacidade de 300 petaflops.

Planejado para ser lançado nos próximos meses, Horizon, o maior supercomputador acadêmico dos Estados Unidos substituirá o atual supercomputador nº 1 nas universidades americanas, o Frontera, no Texas Advanced Computing Center (TACC), servindo como plataforma para a ciência aberta e a pesquisa científica. O cluster de computação de alto desempenho (HPC, na sigla em inglês) está sendo construído com parceria da Dell Technologies e financiado pela Fundação Nacional de Ciência dos EUA (NSF).

A convite da Dell, o Convergência Digital conheceu o Texas Advanced Computing Center, em Austin, onde quatro supercomputadores, incluindo o Frontera, dividem um grande espaço. As máquinas atendem a 400 universidades dos Estados Unidos e parceiros internacionais, oferecendo acesso remoto para pesquisadores. Qualquer pessoa que realize pesquisas não confidenciais, ou seja, aquelas que serão publicadas em periódicos públicos, na maioria das vezes, vinculada a universidades, podem usufruir infraestrutura, conforme explicou a este veículo Dan Stanzione, diretor-executivo do TACC e vice-presidente associado de pesquisa da Universidade do Texas, em Austin.

O data center também atende a algumas empresas e fundações privadas, em projetos que podem envolver desde simulação climática até inteligência artificial. “O Frontera era o nosso maior supercomputador até o momento; o Horizon assumirá esse posto daqui a alguns meses”, disse. Horizon se somará a quatro grandes supercomputadores em operação, cada um deles é composto por milhares de servidores Dell. “O Frontera, por exemplo, possui cerca de 450.000 processadores distribuídos em 8.500 servidores Dell. Nós os agrupamos em clusters para formar um único e grande supercomputador. Todos eles estão interconectados”, detalhou Stanzione.

O atual Frontera recebeu investimentos de US$ 60 milhões e abriu novas possibilidades na ciência e na engenharia ao fornecer uma capacidade computacional que permitiu aos pesquisadores enfrentar desafios de pesquisa muito maiores e mais complexos, abrangendo um amplo espectro de domínios. Implantado em junho de 2019, o Frontera é o supercomputador mais rápido instalado em um campus universitário nos Estados Unidos. O acesso inicial aos usuários teve início em junho de 2019, e o sistema entrou em plena operação em setembro de 2019.

O Frontera utiliza refrigeração líquida — em vez de ar — e tem servido como uma espécie de protótipo para o projeto Horizon. Unidades Nvidia Grace Hopper são combinações de CPU e GPU,exigindo o máximo do sistema de refrigeração a ar.

“Os novos componentes são tão densos que tivemos que limitar a carga a cerca de 35.000 watts e parar por aí. E, a propósito, a densidade é um fator importante para nós. Quer dizer, as máquinas aqui na frente não são tão densas, mas, na área Frontera, verão que as bandejas de cabos no teto estão completamente repletas de fibra óptica, conectando-se diretamente aos switches centrais. E quando executamos tarefas em grande escala — se a tarefa roda em apenas um servidor, a densidade não faz muita diferença”, contou Dan Stanzione.

Latência é fundamental

Stanzione ressaltou que a latência é muito importante e, por isso, há cabos de fibra ótica por todos os cantos. “Se, por exemplo, tivermos um usuário utilizando mil servidores com GPUs para realizar um grande treinamento de LLM ou uma simulação complexa, a velocidade de comunicação entre eles torna-se crucial”, disse. Por isso, cada processador ou servidor fica responsável por um “cubo” dessa grade, não sendo possível avançar no tempo da simulação até que todos os dados tenham sido trocados entre os servidores. Existe um processo equivalente a esse nas operações de inferência e nos treinamentos de aprendizado de máquina. “Portanto, a velocidade com que um servidor consegue se comunicar com outro acaba limitando a velocidade geral de processamento”, explicou.

O tempo que leva para o primeiro bit de informação ser transmitido de um servidor para o outro é algo de extrema importância em um projeto como Frontera. E um dos componentes da latência é o comprimento dos cabos. “Mesmo com fibra óptica, ainda estou limitado à velocidade da luz dentro da fibra, a percorre uma certa distância nesse bilionésimo de segundo”, detalhou. São cerca de três nanossegundos por metro ao longo da fibra.

Entender isso é importante para compreender o impacto de não usar o Frontera em sua plena capacidade. “Se eu tiver uma rede mais lenta ou uma latência maior; e tiver que reduzir a velocidade da minha máquina em 30%, estou utilizando 30% a menos da capacidade do Frontera, simplesmente, por ter posicionado os racks mais distantes uns dos outros; e isso parece uma estupidez. Então, é por isso que projetamos para obter alta densidade — não apenas porque gostamos de densidade, mas porque isso reduz a latência da nossa rede e conseguimos aproveitar melhor a máquina, se conseguirmos mantê-la compactada de forma extremamente densa.”

Na época de processamento em nuvem pré-IA, Dan Stanzione conta que os provedores comerciais de nuvem costumavam utilizar racks de densidade muito baixa, ocupando uma área física muito maior, porque o que importava era a concentração de energia. Não fazia muita diferença a velocidade com que os sistemas conseguiam se comunicar entre si. Mas, agora, com todos estão executando cargas de trabalho de IA, é preciso reestruturar as instalações para se assemelharem mais a data centers de HPC (computação de alto desempenho), pois a latência tornou-se um fator crítico.

O data center conta com tubulações passando sob o piso elevado. Há gabinetes que não possuem iluminação — identificados com a sigla IRC (in-row chillers ou resfriadores de corredor) — que são, basicamente, equipamentos conectados à tubulação que corre sob o piso. Eles funcionam como grandes radiadores: captam o ar quente na parte traseira dos corredores e o devolvem ao ambiente já resfriado. Ou seja, o ar quente na parte de trás das fileiras é expelido como ar frio pela frente das unidades IRCs; e os servidores simplesmente o “sugam” de volta para se manterem resfriados.

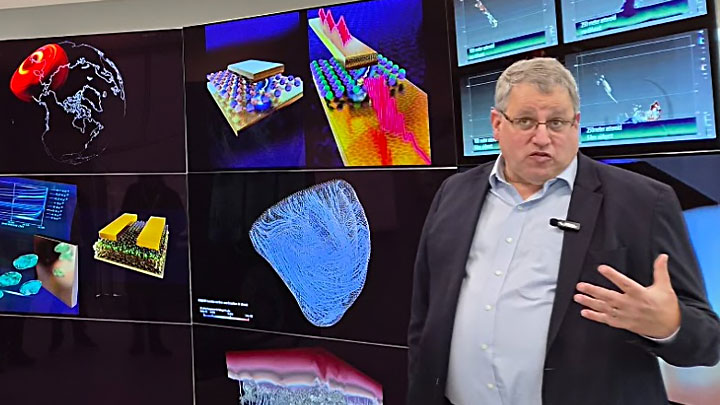

Além dos supercomputadores, o TACC tem uma área de visualização de dados. Uma das formas de interpretarmos os dados provenientes das simulações ou da análise de grandes instrumentos científicos é por meio da visualização gráfica. No painel de exibição gigante, composto por várias telas 4K conectadas a computadores independentes situados na parte traseira, cria-se uma única área de trabalho gigantesca.

Na pequena amostra do trabalho científico realizado ali, é possível ver imagens que representam as diversas correntes de vento e padrões climáticos globais; baterias de íons de sódio, possivelmente, para substituir as baterias de íons de lítio; movimentos fetais reconstruídos a partir de dados sonoros que podem ser captados com um celular; a formação de galáxias primordiais, entre outros.

Ali são executadas dezenas de projetos anualmente com assistência específica na criação das visualizações. Há também os que realizam análises de dados baseadas em IA e alguns apenas examinam grandes planilhas.

Horizon e seus grandes números

Construído com base na Dell AI Factory com Nvidia, o Horizon oferecerá aos pesquisadores capacidades de HPC e IA para endereçar problemas complexos que vão desde as mudanças climáticas até os avanços médicos e a física fundamental. Servidores Dell PowerEdge com computação acelerada Nvidia atuarão como o motor de HPC do Horizon para ajudar os pesquisadores a impulsionar descobertas científicas.

A expectativa é que Horizon inaugure uma nova era de ciência aberta e descobertas, constituindo a peça central da nova Leadership-Class Computing Facility (NSF LCCF) da National Science Foundation (NSF), um recurso que se equipara a iniciativas científicas icônicas, tais como o Telescópio Espacial James Webb e o Observatório de Neutrinos IceCube.

O Horizon contabilizará grandes números: 300 petaflops, dez vezes mais que o atual Frontera, 4 mil GPUs Nvidia e 1 milhão de núcleos CPU. Na base do Horizon estão os Dell Integrated Rack Scalable Systems (IRSS), equipados com servidores Dell PowerEdge com resfriamento líquido direto, contendo a plataforma Nvidia Grace Blackwell e CPUs Nvidia Vera com 1 milhão de núcleos de CPU e 4.000 GPUs Nvidia interconectadas pela rede Nvidia Quantum-X800 InfiniBand de alto desempenho. O Dell IRSS foi projetado para os workloads de IA mais intensivos, maximizando espaço e eficiência para atender às necessidades de computação de alta densidade do TACC.

Este sistema de alta performance contará com 300 petaflops — uma melhoria de 10× na velocidade de simulação em comparação com o sistema Frontera do TACC, atualmente o supercomputador acadêmico nº 1 dos EUA. Quando entrar em operação em 2026, o Horizon ajudará cientistas a enfrentarem problemas que antes estavam fora de alcance e impulsionará pesquisas que fortalecem a liderança dos EUA em ciência, IA e inovação.

Dan Stanzione compartilhou que o planejamento do Horizon começou em 2017 — “muito antes de o ChatGPT sequer existir” — e houve uma guinada estratégica para focar mais na IA. Assim, enquanto o Frontera é composto majoritariamente por CPUs — com apenas algumas centenas de GPUs —, o Horizon contará com milhares de GPUs e representa um investimento muito maior em GPUs, em proporção ao orçamento total da máquina e do que teriam feito cinco ou seis anos atrás.

“Essa é a demanda atual, pois o cenário mundial está mudando. Estamos vivenciando uma verdadeira explosão na demanda por IA, até mesmo na área científica. Veja bem: embora existam cargas de trabalho específicas de IA — por exemplo, na descoberta de novos medicamentos, onde a IA analisa dezenas de milhares de artigos científicos para formular hipóteses sobre quais fármacos testar —, o passo seguinte desse processo é, invariavelmente, a execução de uma série de simulações tradicionais. Portanto, até mesmo as cargas de trabalho de IA acabam impulsionando a demanda por mais simulações tradicionais”, explicou o diretor e VP.

* Roberta Prescott foi ao Texas Advanced Computing Center a convite da Dell